Битва за открытое искусственное интеллекта в свете генеративного искусственного интеллекта

Битва за ОИИ в свете ГИИ

Открытый искусственный интеллект быстро перестраивает программную экосистему, делая модели и инструменты искусственного интеллекта доступными для организаций. Это приводит к ряду преимуществ, включая ускоренную инновацию, улучшенное качество и снижение затрат.

По данным отчета OpenLogic на 2023 год, 80% организаций используют больше открытого ПО по сравнению с прошлым годом (77%) для доступа к последним инновациям, улучшения скорости разработки, снижения зависимости от поставщика и минимизации затрат на лицензии.

Текущая ситуация в области открытого искусственного интеллекта все еще развивается. Крупные технологические гиганты, такие как Google (Meena, Bard и PaLM), Microsoft (Turing NLG) и Amazon Web Services (Amazon Lex), более осторожно выпускают свои инновации в области искусственного интеллекта. Однако некоторые организации, такие как Meta и другие исследовательские компании, активно открывают исходный код своих моделей искусственного интеллекта.

Более того, ведется ожесточенная дискуссия о возможностях открытого искусственного интеллекта, связанная с его потенциалом поставить под угрозу крупные технологические компании. Целью данной статьи является проведение всестороннего анализа потенциальных преимуществ открытого искусственного интеллекта и выявление перед ним стоящих вызовов.

- Динамическое ценообразование с обучением с подкреплением с нуля Q-обучение

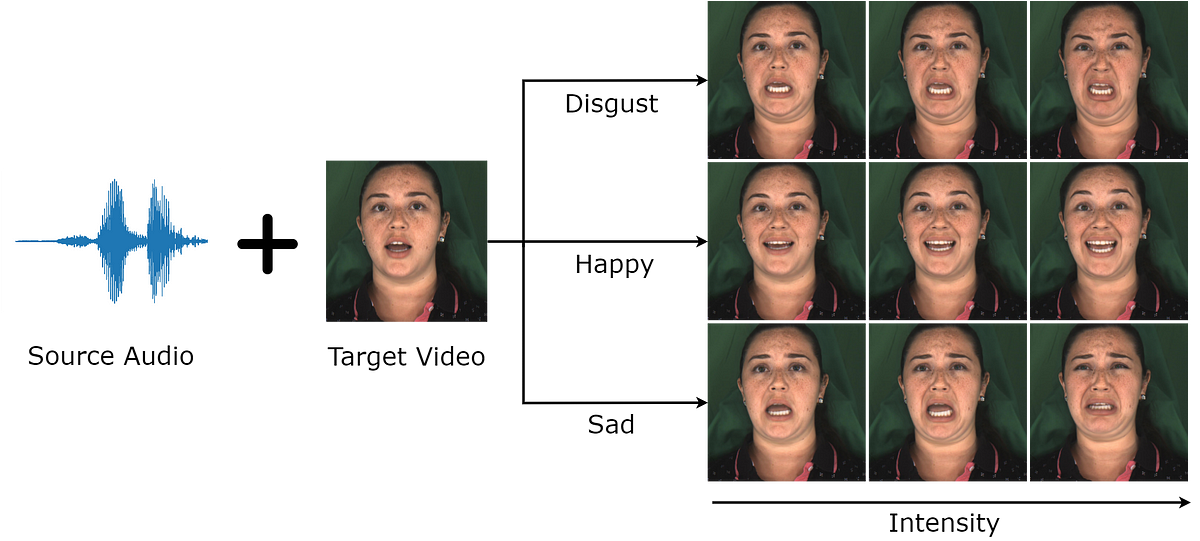

- Meta AI представляет SeamlessM4T основную многоязыковую и многозадачную модель, которая безупречно переводит и расшифровывает речь и текст.

- Познакомьтесь с TADA мощным методом искусственного интеллекта для преобразования вербальных описаний в выразительных 3D-аватаров

Первопроходческие достижения – потенциал открытого искусственного интеллекта

Многие практики считают развитие открытого искусственного интеллекта положительным явлением, поскольку оно делает искусственный интеллект более прозрачным, гибким, ответственным, доступным и доступным по цене. Однако технологические гиганты, такие как OpenAI и Google, очень осторожны при открытии своих моделей из-за коммерческих, конфиденциальных и проблем безопасности. Путем открытия исходного кода они могут потерять конкурентное преимущество, либо им придется раскрывать конфиденциальную информацию о своих данных и архитектуре модели, и злоумышленники могут использовать модели во вред.

Однако самая ценная часть открытия моделей искусственного интеллекта – это более быстрое развитие. Несколько значимых достижений в области искусственного интеллекта стали доступны для общественности благодаря совместной разработке с открытым исходным кодом. Например, Meta сделала прорыв, открыв исходный код своей модели LLM под названием LLaMA.

Получив доступ к LLaMA, научное сообщество стимулировало дальнейшие прорывы в области искусственного интеллекта, что привело к созданию производных моделей, таких как Alpaca и Vicuna. В июле компания Stability AI создала две модели LLM с названиями Beluga 1 и Beluga 2, используя LLaMA и LLaMA 2 соответственно. Они продемонстрировали лучшие результаты во многих языковых задачах, таких как рассуждение, вопросно-ответные системы в определенных областях и понимание языковых тонкостей по сравнению с передовыми моделями на тот момент. Недавно Meta представила Code LLaMA – инструмент искусственного интеллекта с открытым исходным кодом для написания кода, который превзошел передовые модели в задачах написания кода – также построенный на основе LLaMA 2.

Сравнение производительности Code LLaMA

Исследователи и практики также расширяют возможности LLaMA, чтобы конкурировать с проприетарными моделями. Например, открытые модели, такие как Giraffe от Abacus AI и Llama-2-7B-32K-Instruct от Together AI, теперь способны обрабатывать контексты длиной до 32 тыс. символов – функцию, которая ранее была доступна только в проприетарной модели LLM, такой как GPT-4. Кроме того, индустриальные инициативы, такие как открытые модели MPT 7B и 30B от MosaicML, позволяют исследователям обучать свои генеративные модели искусственного интеллекта с нуля.

В целом, этот коллективный подход преобразил область искусственного интеллекта, способствуя сотрудничеству и обмену знаниями, которые продолжают вести к новаторским открытиям.

Преимущества открытого искусственного интеллекта для компаний

Открытый искусственный интеллект предлагает множество преимуществ, делая его привлекательным подходом в области искусственного интеллекта. Благодаря прозрачности и сотрудничеству, основанному на сообществе, открытый искусственный интеллект имеет потенциал изменить способ разработки и внедрения искусственного интеллекта.

Вот некоторые преимущества открытого искусственного интеллекта:

- Быстрое развитие: Открытые модели искусственного интеллекта позволяют разработчикам строить на основе существующих фреймворков и архитектур, обеспечивая быстрое развитие и итерацию новых моделей. Имея прочную основу, разработчики могут создавать новаторские приложения, не изобретая велосипед заново.

- Увеличенная прозрачность: Прозрачность является ключевой особенностью открытого искусственного интеллекта, обеспечивая ясное представление о базовых алгоритмах и данных. Эта видимость снижает предвзятость и способствует справедливости, создавая более справедливую среду искусственного интеллекта.

- Увеличенное сотрудничество: Открытый искусственный интеллект демократизировал разработку искусственного интеллекта, что способствует сотрудничеству и созданию разнообразного сообщества участников с различными навыками.

Преодоление вызовов – риски открытого искусственного интеллекта

В то время как открытый исходный код предлагает множество преимуществ, важно быть осведомленным о потенциальных рисках, которые он может нести. Вот некоторые из основных проблем, связанных с открытым искусственным интеллектом:

- Регуляторные проблемы: Рост открытых моделей искусственного интеллекта привел к неограниченному развитию с внутренними рисками, требующими тщательного регулирования. Простой доступность и демократизация искусственного интеллекта вызывают опасения относительно его возможного злонамеренного использования. Согласно недавнему отчету от SiliconAngle, некоторые проекты открытого искусственного интеллекта используют генеративный искусственный интеллект и LLMs с плохой безопасностью, ставя организации и потребителей в опасность.

- Деградация качества: В то время как открытые модели искусственного интеллекта обеспечивают прозрачность и сотрудничество сообщества, они могут страдать от деградации качества со временем. В отличие от закрытых моделей, поддерживаемых специализированными командами, бремя поддержки часто ложится на сообщество. Это часто приводит к возможному пренебрежению и устаревшим версиям моделей. Эта деградация может затруднить осуществление важных приложений, подвергая опасности доверие пользователей и общий прогресс искусственного интеллекта.

- Сложность регулирования искусственного интеллекта: Открытое распространение моделей искусственного интеллекта вводит новый уровень сложности для регуляторов искусственного интеллекта. Есть несколько факторов, которые необходимо учесть, такие как защита конфиденциальных данных, предотвращение использования моделей в злонамеренных целях и обеспечение их поддержки. Поэтому для регуляторов искусственного интеллекта довольно сложно гарантировать, что открытые модели используются для блага, а не для вреда.

Развивающаяся природа дебатов об открытом искусственном интеллекте

“Открытый исходный код способствует инновациям, потому что позволяет множеству разработчиков работать с новой технологией. Он также повышает безопасность, потому что когда программное обеспечение открыто, больше людей могут его изучать, чтобы выявить и исправить возможные проблемы”, – сказал Марк Цукерберг, когда в июле этого года он объявил о крупной модели языка LLaMA 2.

С другой стороны, крупные игроки, такие как OpenAI, поддерживаемый Microsoft, и Google, закрыты своими системами искусственного интеллекта. Они стремятся получить конкурентное преимущество и минимизировать риск неправомерного использования искусственного интеллекта.

Соучредитель и главный ученый OpenAI, Илья Суцкевер, рассказал The Verge, “Эти модели очень мощные, и они становятся все более и более мощными. В какой-то момент будет довольно легко, если понадобится, нанести большой вред с помощью этих моделей. И по мере увеличения возможностей, имеет смысл не раскрывать их”. Таким образом, существуют потенциальные риски, связанные с открытыми моделями искусственного интеллекта, которые люди не могут игнорировать.

В то время как искусственный интеллект, способный причинить вред человеку, может быть отдаленной перспективой на десятилетия, уже происходило злоупотребление открытыми инструментами искусственного интеллекта. Например, первая модель LLaMA была выпущена только для продвижения исследований в области искусственного интеллекта. Но злонамеренные агенты использовали ее для создания чат-ботов, распространяющих ненавистный контент, такой как расистские высказывания и стереотипы.

Поддержание баланса между сотрудничеством в области искусственного интеллекта и ответственным управлением является важным. Это гарантирует, что достижения в области искусственного интеллекта остаются полезными для общества, одновременно защищая от потенциального вреда. Технологическое сообщество должно сотрудничать для установления руководящих принципов и механизмов, способствующих этическому развитию искусственного интеллекта. Более того, необходимо предпринимать меры для предотвращения злоупотребления, чтобы искусственный интеллект стал силой позитивного изменения.

Хотите улучшить свои знания об искусственном интеллекте? Ознакомьтесь с обширным каталогом полезных ресурсов по искусственному интеллекту на Unite.ai, чтобы расширить свои знания.