reinforcement learning : Daftar 10 Situs Slot Online Terpercaya rupython

Yuk, Intip Lebih Dalam Situs reinforcement learning Yang Berkualitas

Penundaan Laga Imbas Virus Corona, Simon Kjaer: Masa Yang Aneh | Goal.com Indonesia Berita Serie A Vincenzo Montella Ingin Lanjutkan Proyek AC Milan | Goal.com Indonesia syairsdykalong Resmi Buka Asean Para Games Solo 2022, Wapres KH. Ma’ruf Amin: Para Games Ajang Istimewa Karena Sumber Inspirasi Tentang Kesetaraan Persiapan Bhayangkara FC Sudah Afdal Lawan Arema FC | Goal.com Indonesia Top 3 Sports: Man City Juara Liga Inggris, Sananta Disambut Meriah Sudirman Sebut Taufik Hidayat Punya Kelebihan Dibanding Marko Simic | Goal.com Indonesia syairssy Siapa Alejandro Garnacho? Sensasi Satu Malam Manchester United Yang Prospektif | Goal.com Indonesia Stefano Cugurra Belum Mau Prediksi Perebutan Gelar Juara | Goal.com Indonesia Barcelona Ungkap Isi Pertemuan dengan Agen Lionel Messi reinforcement learning Redenominasi Jangan Tiba-Tiba, Wong Cilik Bisa Bingung Real Madrid Jumpa Chelsea Di Semi-Final Liga Champions, Thibaut Courtois Siap Reuni | Goal.com Indonesia Hadir di Wisuda SMP Al Izhar Pondok Labu, Menpora Dito Motivasi Agar Seluruh Siswa Terus Kembangkan Kreativitas

Yuk, Intip Lebih Dalam Situs reinforcement learning Yang Berkualitas! Bermain tentunya menjadi salah satu kegiatan dari sedikitnya kegiatan menyenangkan yang dapat Anda lakukan. Jelas saja,reinforcement learning berbeda dengan bekerja, saat bermain semua beban yang ada dalam benak Anda akan menghilang. Maka karena itu, menjadi hal yang sangat wajar bila saat ini semua dari Anda dapat menemukan aplikasi permainan di ponsel dengan mudah.

Nilmaizar Ingatkan Pemain Persela Lamongan Tidak Terlena | Goal.com Indonesia Kantor Pertanahan Serahkan Sertifikat Stadion GBLA dan Taman Lalu Lint syairsdy17 REVIEW Serie A Italia: Crotone Bertahan, Palermo Bikin Empoli Terdegradasi | Goal.com Indonesia Jokowi Akan Beri 'Subsidi' ke Pertalite? Ini Kata Pertamina PSIS Semarang Turunkan Intensitas Latihan | Goal.com Indonesia PREVIEW Kualifikasi Piala Dunia 2018: Prancis - Luksemburg | Goal.com Indonesia kodesyairmlmini VIDEO: Menhub Soal Cuti Bersama Idul Fitri 19 April Laporan Pertandingan: AS Roma vs Sassuolo | Goal.com Indonesia Erdogan Tiba-Tiba Ngamuk ke AS, Ada Apa? reinforcement learning Video: QRIS Makin Sakti, Kini Bisa Digunakan di Jepang Hasil Pertandingan: Polandia 2-3 Portugal | Goal.com Indonesia Gavin Kwan Adsit Anggap Uji Coba Kontra Korea Selatan U-23 Penting | Goal.com Indonesia

Akan tetapi, selain menggunakan aplikasi, ada hal lain yang dapat Anda gunakan untuk bermain. Hal tersebut adalah jelajah internet yang masih menjadi bagian dari ponsel Anda. Dengan menggunakan jelajah internet ini, ada banyak permainan menarik yang dapat Anda temukan pula. Salah satunya adalah permainan yang telah menjadi incaran masyarakat luas sejak zaman dahulu.prediksi hk 18 februari 2023 Bahkan, beberapa dari Anda juga mungkin akan memilih permainan ini.

Benar sekali, hal ini dikarenakan hadiah kemenangan yang diberikan oleh permainan yang ada dalam situs ini adalah uang. Tepat sekali, judi menjadi nama lain dari permainan yang saat ini dapat Anda mainkan dalam situs dengan nama reinforcement learning ini. Kami menyarankan semua dari Anda untuk langsung mengunjungi situs yang kami sebut sebelumnya saja saat ingin bermain. Hal ini dikarenakan situs yang kami sebutkan merupakan laman yang aman.

Real Madrid Awali 2022 Dengan Kekalahan Lawan Getafe | Goal.com Indonesia Buah Simalakama Aturan Covid-19 Hong Kong prediksisydney20november2021 Rio Ferdinand Dukung Manchester United Rogoh Kocek Dalam Untuk Jude Bellingham | Goal.com Indonesia Reaksi GOAT Argentina Lionel Messi Usai Juara Piala Dunia: "Saya Tahu Tuhan Pasti Kasih" | Goal.com Indonesia Roberto Firmino Sepakat Tinggalkan Liverpool Di Akhir Musim | Goal.com Indonesia Tol Ini Masih Didiskon Sampai Akhir Mei, Ini Lokasinya syairhongkonglive Pasti Mundur! Gaji Ke-13 PNS Baru Dibahas November 2020 Bakal Ada BNI Sonic di Java Jazz Festival 2020, Apa Itu? AC Milan Alihkan Bidikan Pada Diego Costa | Goal.com Indonesia reinforcement learning Peringatkan Atletico Madrid, Cristiano Ronaldo: Juventus Siap Comeback! | Goal.com Indonesia Jan Vertonghen: Lawan Tahu Cara Bermain Tottenham Hotspur Musim Ini | Goal.com Indonesia Ferarri Cetak Gol, Indonesia vs Vietnam 2-1 di Menit 53

Jelas saja, ada banyak keuntungan yang diberikan oleh laman ini dan tidak hanya berlaku untuk pemenang. Benar, hal ini dikarenakan keuntungan ini berlaku untuk semua dari Anda yang menjadi anggota dari situs ini. Lebih tepatnya, keuntungan ini dapat Anda peroleh dari banyaknya pelayanan terbaik yang biasanya tidak diberikan laman lain.syair togel sabtu Mengetahui hal ini tentunya membuat Anda merasa penasaran dengan laman ini, bukan?

Jreng! China Kirim Tentara ke Rusia, Ikut Perang Ukraina? Firza Andika Pergi Ke Belgia Usai Kualifikasi Piala Asia U-23 | Goal.com Indonesia syairuntukhongkongmalamini 2 Tahun Sekolah Disegel, Ratusan Siswa Ambalau Belajar di Rumah Warga Menpora Amali Harap Sail Tidore ke-XII Tahun 2022 Jadi Ajang Masyarakat Dunia Melihat Keindahan Indonesia Nasib Tragis Pabrik di DKI Tutup & Hancur, Begini Ceritanya Rafael Da Silva: Alexandre Lacazette Bakal Sukses Di Arsenal | Goal.com Indonesia syairvietnamhariini Gelandang Barcelona & Spanyol Pedri Ungkap Rahasia Kebugarannya Sepanjang Musim | Goal.com Indonesia Sekda Kota Bandung Meresmikan Masjid Megah RW 09 Sarijadi Senilai Rp. 1,2 M. Harga Tiket Pesawat Makin 'Meledak', JKT-Bali Rp 1,5 Juta reinforcement learning Berita Transfer - Maurizio Sarri Ikut Buru Adrien Rabiot | Goal.com Indonesia Percuma Harga Mahal, RKAB Tambang Nikel Banyak yang Tertahan Menpora Amali Kembali Tegaskan Pemerintah Tidak Akan Intervensi Proses KLB PSSI

Secara Singkat Situs reinforcement learning Untuk Anda

Kami akan menjawab semua rasa penasaran Anda mengenai situs ini terlebih dahulu. Dengan melakukan hal ini, maka semua pertanyaan yang ada dalam benak Anda tentunya akan menghilang. Sebab, kami akan membuat Anda mengetahui laman ini secara lebih dalam lagi. Hal paling awal yang harus Anda ketahui mengenai laman ini adalah kemudahan yang diberikan kepada Anda sebagai anggota dari laman.

Berita Liverpool FC v Arsenal FC, 13/01/22, League Cup | Goal.com Cek Nih Kado untuk PNS di 2022, Gaji Naik? syairhk13april2022pangkalantoto Barcelona Dipermalukan Cadiz, Xavi: Bisa Susah Masuk Liga Champions Musim Depan! | Goal.com Indonesia Bek Chelsea Antonio Rudiger Bagikan Pizza Untuk 13 Rumah Sakit Di Jerman | Goal.com Indonesia Cristiano Ronaldo Berikan Sepatu Peraknya Pada Nani | Goal.com Indonesia Pengumuman Calon Dewan Pengawas Lembaga Penyiaran Publik Lokal (LPPL) Radio Sonata hk27mei2023 "Musim Terbaik Saya Di Real Madrid" - Karim Benzema Kegirangan Cetak Hat-Trick & Salip Alfredo Di Stefano | Goal.com Indonesia Laporan Pertandingan Piala Dunia 2018: Islandia vs Kroasia | Goal.com Indonesia Eks CEO Bayern Munich Karl-Heinz Rummenigge Minta Maaf Soal Bek Real Madrid David Alaba, Ada Apa? | Goal.com Indonesia reinforcement learning Hore! IKN Siap Dibangun, Seperti Apa Kesiapannya? Jadwal Siaran Langsung Final Voli Putra SEA Games 2023: Indonesia Vs Kamboja Siapa Saja Voter PSSI di KLB 2023?

Saat memutuskan untuk menggunakan situs ini, maka semua dari Anda akan menemukan nominal deposit yang wahai hingga permainan yang beragam. Hal ini jelas merupakan keuntungan untuk semua dari Anda. Akan tetapi, keuntungan ini juga masih menjadi bagian kecil dari situs yang ini.

Tentunya,prediksi hongkong datuk hal ini dapat terjadi karena ada lebih banyak keuntungan yang akan menjadi milik Anda. Beberapa keuntungan tersebut akan menjadi hal yang Anda temukan dalam kalimat selanjutnya. Maka karena itu, cari tahu bersama kami dengan tetap menyimak setiap kalimat yang ada dengan baik.

Jreng! China Tiba-tiba Teleponan dengan Ukraina, Ada Apa? Ini Syarat Perjalanan Kereta Terbaru, Cek! PREVIEW Liga Primer Inggris: Crystal Palace - Chelsea | Goal.com Indonesia Tekan Emisi Karbon, Sub Holding Gas Pertamina Gandeng Korsel Kapten Timnas Indonesia U-19 Tetap Bidik Posisi Ketiga | Goal.com Indonesia Thorgan Hazard Tertarik Kembali Ke Inggris | Goal.com Indonesia gambarborderml Berita Timnas Portugal - Pecundangi Polandia, Fernando Santos Sanjung Skuat Muda Portugal | Goal.com Indonesia Harga Telur 'Terbang' Lagi, di Jakarta Rp33.000 Presiden Atletico Madrid: Lionel Messi, Ayo Susul Luis Suarez! | Goal.com Indonesia reinforcement learning Berita Manchester City - Dikalahkan Wigan Athletic, Sergio Aguero Sikut Fans | Goal.com Indonesia Frank Lampard Buka Suara Setelah Dipecat Chelsea | Goal.com Indonesia Sepuluh WNI Diduga Tertular COVID-19 di India

Keuntungan Situs Permainan Untuk Anda

Situs permainan reinforcement learning sendiri mampu memberikan beragam keuntungan untuk Anda. Tidak akan menjadi hal yang mudah untuk mendapatkan keuntungan dalam beragam agen lainnya. Namun, situs permainan ini mampu memberikan penawaran sempurna dalam permainan hanya dengan pembuatan akun permainan saja.puisi anak rantau Pastinya, ada beberapa keuntungan berikut ini yang akan Anda dapatkan dalam dunia permainan tanpa perlu kesulitan sama sekali.

BLT Jadi Amunisi RI untuk Perang Lawan Corona, Serius Cukup? Jangan Kaget! Hewan Albino Ini Ditawar Rp 1 Miliar syairsdy4dkeraton Muhammad Iqbal Akui Kesulitan Bongkar Pertahanan Brunei Darussalam | Goal.com Indonesia VIDEO: Surya Paloh Akui Sulit Hilangkan Cap Politik Identitas Anies Bang Imam Apresiasi Santunan Yatim Forum PLKP Depok Andrea Ranocchia Masuk Bidikan Huddersfield Town & West Bromwich Albion | Goal.com Indonesia syairhkkraton4d Kenalkan Nusantara, Mahasiswa Indonesia Buka UMKM Kuliner di Australia Anies Ucap Selamat Pencapresan Ganjar: Semoga Demokrasi Makin Matang THR Tercipta Agar Para Buruh Se-Indonesia Lebih Sejahtera reinforcement learning Keagungan Harry Kane Vs Leicester City | Goal.com Indonesia Lumat Amerika Serikat, Belanda Melenggang Ke Perempat-Final Piala Dunia 2022 | Goal.com Indonesia Liverpool vs Tottenham Hotspur: Live Streaming & TV, Prediksi, Susunan Pemain Dan Kabar Terkini | Goal.com Indonesia

Layanan aktif

Anda mendapatkan penawaran sempurna dalam permainan berupa layanan yang aktif. Anda dapat bermain tanpa masalah sama sekali dalam urusan waktu. Semua permainan yang ingin Anda mainkan dapat disesuaikan dengan kenyamanan untuk taruhan.singapura 4d hari ini Para pemain biasanya memikirkan waktu terbaik karena harus menyesuaikan dengan tempat permainan sendiri. Namun, situs ini mmberikan penawaran sempurna untuk permainan dengan akses 24 jam.

Persija Jakarta & Jakmania Gelar Silaturahmi Dengan Wakabaintelkam Mabes Polri | Goal.com Indonesia Laga Terakhir Bali United Bisa Dihadiri Penonton, Suporter Malah Emoh Datang | Goal.com Indonesia syairhkboombatang Persija Jakarta Pastikan Laga Kontra Persebaya Surabaya & Persib Bandung Di Stadion PTIK | Goal.com Indonesia Bhayangkara FC Wajib Punya Mental Juara | Goal.com Indonesia Direksi PDAM Tirta Asasta Depok Periode 2020-2025 Resmi Dilantik Esther Gayatri Saleh : Perempuan Kepala Pilot Uji Satu-satunya di Dunia forumsyairvipsgp UEFA Akan Ganti Rumput Stade Pierre Mauroy | Goal.com Indonesia Optimistis dengan 2021, Bos Pertamina Buka-bukaan Strategi Jelang Final Copa Del Rey, Lionel Messi Sebut Kekalahan Dari Liverpool Ganggu Musim Hebat Barcelona | Goal.com Indonesia reinforcement learning Wow! Produk 'Made in RI' Ini Buat Malaysia Gundah Gulana Mulai Besok, Bandara Halim Kembali Beroperasi! Cek Jadwalnya Pemerintah Belum Mau Buat Event Tandingan Usai Piala Dunia U-20 Batal

Permainan reinforcement learning terbaik

Tidak hanya penawaran untuk permainan selama 24 jam saja. Anda juga mendapatkan layanan lainnya dalam permainan. Hal ini berkaitan dengan banyaknya permainan yang dapat Anda akses tanpa perlu kesulitan sama sekali. Semua permainan mempunyai perbedaannya satu dengan yang lain. Anda dapat meraih kemenangan permainan dengan akses pada permainan yang tepat.bocoran hk 16 april 2023 Hal ini tidak akan menyulitkan Anda dalam permainan.

Didier Deschamps: Olivier Giroud Penting Untuk Timnas Prancis | Goal.com Indonesia UMP Swasta Sudah, Gaji PNS Harusnya Juga Naik 7% Tahun Depan syairsdy14februari2023 PREVIEW Coppa Italia: Juventus - Torino | Goal.com Indonesia Berita Liga Jerman - Philippe Coutinho: Bayern Munich Ambisius, Demikian Juga Saya | Goal.com Indonesia Gianluigi Donnarumma: Saya Selalu Takut Menghadapi Cristiano Ronaldo | Goal.com Indonesia Simak Baik-baik! Ini Jenis Pekerjaan untuk Pekerja Kontrak syairhk02 Kapten Timnas Indonesia U-19 Tetap Bidik Posisi Ketiga | Goal.com Indonesia Survei: Elektabilitas Ganjar, Prabowo, Anies Lebih Kecil di Perempuan Michael Carrick Gembira Mainkan Laga Testimonial | Goal.com Indonesia reinforcement learning Permintaan Ketua Umum PSSI Mochamad Iriawan Buat Suporter & Skuad Timnas Indonesia | Goal.com Indonesia Penyusunan Dokumen Rencana Pembangunan Jangka Menengah Daerah (RPJMD) Kota Bandung Tahun 2019-2023 Jokowi Punya 24 Jabatan Wamen, Kursi Mana Saja yang Kosong?

Tampilan permainan menarik

Anda pastinya ingin mendapatkan penampilan permainan yang sempurna untuk suasana yang jauh lebih menarik. Tidak akan jadi hal yang seru jika permainan hanya dapat Anda akses dengan warna biasa saja. Situs permainan ini memberikan beragam fitur menarik sehingga semua permainan jauh lebih menarik. Walaupun permainan dimainkan secara daring, Anda tetap mendapatkan keseruan dalam permainan sendiri.

Kebal Resesi, Ekonomi Jerman Tumbuh di Atas Ekspektasi Busuk di Grup, Kane Simpan Ancaman Bahaya di Fase Gugur Piala Dunia syairmbahsemarhk23april2023 Jangan Kaget! Harga BBM di Seluruh SPBU RI Sudah Naik Turis Asing Liburan ke RI Makin Ramai, Jurus Jokowi Berhasil? Siap-siap! Tangerang Raya Berlakukan PSBB per 18 April 2020 Berita Manchester United FC v West Ham United FC, 22/07/20, Liga Primer | Goal.com syairhongkong9maret2023 Berita EPL - Wes Brown: Ole Gunnar Solskjaer Punya Kesempatan Jadi Manajer Permanen Manchester United | Goal.com Indonesia Kisah Tim Persebaya Diberi Waktu 5 Menit Keluar dari Kanjuruhan Sri Mulyani: Harusnya Harga Pertalite Rp 14.450/Liter reinforcement learning Airlangga Perintahkan Percepatan Vaksinasi PMK Liga 1 2019: Pemain Borneo FC Bikin Mario Gomez Bangga | Goal.com Indonesia Makan Konate Bicara Soal Kualitas Marko Simic & Rohit Chand | Goal.com Indonesia

Dasar Dalam Permainan Daring

Akun permainan

Anda harus mempunyai akun permainan dalam situs reinforcement learning lebih dulu. Hal ini berkaitan dengan permainan penghasil uang yang tepat. Hanya agen permainan aman saja yang dapat memberikan keuntungan untuk Anda. Penting sekali untuk membuat akun dalam agen permainan yang aman.

KWT Selendang Ratu Ratu Jaya Miliki Kebun Hidroponik Berkonsep Green House Mark Clattenburg Pimpin Laga Italia Kontra Belgia | Goal.com Indonesia totobetshio Brigjen Endar Geram Dilarang Masuk KPK: Saya Masih Berhak di Sini Massimiliano Allegri Tidak Khawatirkan Rekor Buruk Juventus Di Final | Goal.com Indonesia Turki Tutup Perbatasan Karena Corona Pejabat Desa' Ramai-Ramai Kepung Jakarta, Mau Apa? syairsgptgl5maret2023 Musrenbang Kecamatan Diharapkan Bisa Akomodir Usulan Kegiatan Kepemudaan BEST XI: Levain Cup 2016 | Goal.com PSM Makassar Resmi Kontrak Ezra Walian Jangka Panjang | Goal.com Indonesia reinforcement learning Proses Naturalisasi 3 Pemain Timnas U-20 Masuk Kemensetneg Vietnam U16 v Indonesia U16 Laporan Pertandingan, 27/07/19, AFF U16 Championship | Goal.com Nyaris Mirip Kanjuruhan, Warga Terinjak-injak di Stadion Irak

Modal bermain

Anda perlu hal lainnya dalam permainan berupa modal. Penting sekali halnya untuk taruhan dengan biaya yang cukup.kode syair hk 7 april 2022 Anda harus melakukan langkah yang tepat dalam permainan dengan biaya untuk taruhan sepenuhnya.

Suasana RS Covid-19 Wisma Atlet Jelang Penutupan 31 Desember Persipura Jayapura vs TIRA Persikabo: Live Streaming & TV, Prediksi, Susunan Pemain Dan Kabar Terkini | Goal.com Indonesia syairhk3juli2022 Top! Laba Pertamina Hulu Rokan Melejit 254,3%, Tembus Rp25 T Berita Transfer Pemain: Ole Gunnar Solskjaer Isyaratkan Manchester United Tak Beli Pemain | Goal.com Indonesia Apa yang Terjadi Jika Raja Salman Meninggal? Ini Jawabnya Pasien Covid di RS Menurun, 60% Tidak Bergejala & Ringan syairsgp13 Tes Covid di China Sepi, Efek Pelonggaran Kebijakan Chelsea Mesem-mesem, Bintang AC Milan Rafael Leao: Siapa Sih Yang Enggak Mau Ke Liga Primer Inggris? Itu Masa Depan! | Goal.com Indonesia Honda Keluarkan Motor 'Penghancur' Vespa, Canggih Harga Murah reinforcement learning Dua Penyuap Wakil Ketua DPRD Jatim Divonis 2,5 Tahun Penjara Legasi Mohamed Salah Di Liverpool Dibandingkan Dengan Steven Gerrard, Ian Rush & Yang Lainnya - Sang Raja Mesir Ada Di Mount Rushmore Milik Anfield | Goal.com Indonesia REVIEW Piala Asia 2019: Vietnam Buka Asa Lolos | Goal.com Indonesia

Mengenal dunia judi

Mustahil halnya Anda mendapatkan keuntungan dalam permainan tanpa adanya pemahaman akan permainan judi sendiri. Anda harus mengenal permainan ini lebih dulu untuk akses yang lebih mudah. Penting melakukan pemilihan pada permainan yang tepat. Anda tidak akan bermain dengan tepat tanpa mempunyai pengalaman dalam dunia permainan judi sendiri.

Pelatih Selangor FA Bela Andik Vermansah | Goal.com Indonesia 61 Orang Masuk Daftar Hitam Putin! Ada Menkeu AS syairbatikhkhariini Mau Nggak? Ada Pekerjaan Digaji Tapi Tak Melakukan Apa-Apa DPRD Apresiasi Pemkot Bandung Soal Persiapan Jelang Idulfitri Berita Manchester United - Ole Gunnar Solskjaer: Paul Pogba Gelandang Fantastis! | Goal.com Indonesia Ukraina Berharap Sobat Putin Ini Dieksekusi Rakyatnya Sendiri forumsyairhkpetruk PM Kanada Buka Suara soal Demo Massal di China, Ini Katanya TONTON: Antara Ronaldinho & Ramires, Gol Terbaik Dalam Rivalitas Barcelona Versus Chelsea | Goal.com Indonesia Berita Espanyol v Real Madrid, 03/10/21, LaLiga | Goal.com reinforcement learning Gara-gara Ini, Pengusaha Bakal 'Mager' Investasi Tahun Depan China Tuding AS Provokasi Ketegangan di Selat Taiwan Kampusnya Jadi Sentra Implementasi DBON, Rektor: UPI Siap Berkontribusi Terhadap Prestasi Olahraga Nasional

Beberapa hal ini penting dalam dunia permainan reinforcement learning. Menangkan permainan tanpa perlu repot sama sekali. Anda dapat melakukan cara yang sederhana untuk mendapatkan keuntungan besar.gambar semar mesem asli Situs permainan yang tepat harus Anda gunakan untuk keuntungan yang besar dalam dunia permainan daring. Gunakan cara tepat untuk beragam keuntungan dalam dunia permainan.

PAN soal Isu Golkar Pindah Koalisi: Inginnya KIB Selalu Bersama Laga Pekan 22 Liga 2 2018 Digelar Bersamaan | Goal.com Indonesia syairsydneyselasa "Belum Ada Tanggal Resmi" - PT LIB Jawab Kabar Liga 1 Dimulai 5 Februari 2021 | Goal.com Indonesia Berita Burnley FC v Liverpool FC, 19/05/21, Liga Primer | Goal.com Tony Sucipto Doakan Karier Achmad Jufriyanto Semakin Berkembang Di Malaysia | Goal.com Indonesia Liga 1 2019: Taklukkan Semen Padang, Perseru Badak Lampung FC Makin Percaya Diri | Goal.com Indonesia syairsdy18april2022 Ernesto Valverde: Miliki Lionel Messi Adalah Kemewahan | Goal.com Indonesia 5 Fakta Menarik di Semifinal Liga Champions 4 Catatan Menyedihkan di Balik Kekalahan Telak Tottenham Hotspur reinforcement learning Man City Patut Waspada Jebakan Lama Klopp Berita Manchester United FC v West Ham United FC, 22/07/20, Liga Primer | Goal.com Arsene Wenger: Luis Suarez Ingin Gabung Arsenal | Goal.com Indonesia

reinforcement learning Situs Judi Poker Domino QQ Terpercaya

reinforcement learning merupakan situs judi togel slot online terpercaya no 1 di indonesia yang menghadirkan ratusan jenis permainan reinforcement learning gacor terlengkap mudah jackpot..

Permainan yang disediakan reinforcement learning adalah Bandarq, Poker Online, Bandar Poker, Bandar Sakong, Bandar66, Capsa Susun, Perang Baccarat, AduQ dan DominoQQ Online.

Hasil Pertandingan: Persija Jakarta 2-1 Mitra Kukar | Goal.com Indonesia Berita RB Leipzig v Hertha BSC, 24/10/20, Bundesliga | Goal.com datatotobethk Manchester City Masih Bisa Ikut Liga Champions Musim Depan | Goal.com Indonesia Duel Papan Atas Bundesliga, RB Leipzig Atasi Bayer Leverkusen | Goal.com Indonesia Kebersamaan Lyon & Jean-Michel Aulas Selama 30 Tahun Lebih Harus Berakhir | Goal.com Indonesia Berita AC Milan - Stefano Pioli Jadi Kandidat Kuat Pelatih Baru AC Milan | Goal.com Indonesia prediksisyairhk20maret2023 Piala AFF U-15: Ditahan Imbang Timor Leste, Bima Sakti Tetap Bersyukur | Goal.com Indonesia TONTON: David De Gea Blunder Lagi! Jadi Biang Kerok Kekalahan Manchester United Dari West Ham | Goal.com Indonesia Kasus Covid-19 RI Tertinggi di Asia Tenggara, Benarkah? reinforcement learning Israel Ikut Terseret Konflik Rusia-Ukraina, Perang Dunia? Pelindo Peti Kemas Perluas Wilayah Operasional Perusahaan Sorot Sepekan (21-27 Agustus): Bali United Juara Paruh Musim Liga 1 2019 | Goal.com Indonesia

Keunggulan yang Dimiliki Situs reinforcement learning

Situs reinforcement learning memiliki Keunggulan yang Tentunya Memuaskan Kamu Sebagai Pemain Judi Online.

- Server yang Always On, jarang maintenance.

- Berbagai link login alternatif

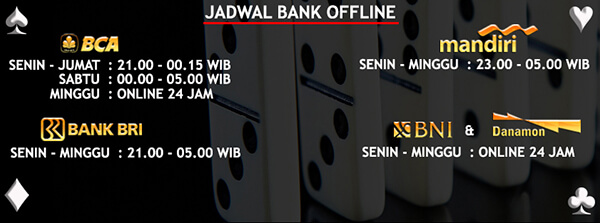

- Berbagai bank alternatif yang disediakan

- Bonus-bonus yang diberikan tentunya menarik

- Akun yang dijamin keamanannya

- Transaksi yang aman dan cepat

- Didukung oleh Customer Service yang ramah dan responsif

- Permainan yang disediakan Sangat Lengkap

Bonus Menarik Dari reinforcement learning

Situs reinforcement learning memberikan bonus yang menarik untuk semua member yang bergabung. Bonus untuk member baru dan member lama adalah sama. Kamu juga bisa mendapatkan bonus Turnover jika ada bermain. Tentu kamu juga bisa mendapatkan bonus tanpa bermain,syair sidney buat hari ini yaitu caranya dengan mengajak temanmu daftar dan bermain dengan kode referral kamu.

Mitra Kukar v Persija Laporan Pertandingan, 21/07/18, Liga 1 | Goal.com Kalteng Putra vs Persija Jakarta: Preview, Jadwal TV & Kabar Terkini Skuad | Goal.com Indonesia prediksisyairhk14mei2022pangkalantoto Debut Di Slowakia, Egy Maulana Vikri Langsung Cetak Assist | Goal.com Indonesia Video: Indonesia Siap Geber Literasi Keuangan Syariah Djadjang Nurdjaman: Performa Persib Bandung Jauh Di Bawah Harapan | Goal.com Indonesia "Mohamed Salah-nya Chelsea" - Thomas Tuchel Sebut NGolo Kante Juru Selamat | Goal.com Indonesia syairsdytogoghariini Piala AFF U-19 2022: Myanmar Pesta Gol, Thailand Susah Payah Bekuk Filipina | Goal.com Indonesia Heboh Korut Tembak Rudal Seminggu 2 Kali, Kenapa Kim Jong Un? Kiper Manchester United Dean Henderson Mulai Pulih Dari Long Covid | Goal.com Indonesia reinforcement learning Peneliti Ini Bongkar Misteri Kuntilanak di RI, Jangan Kaget! Berita Milan v Bologna, 18/07/20, Serie A | Goal.com Hasil Pertandingan: Uni Emirat Arab 3-2 Kyrgyzstan | Goal.com Indonesia

Untuk bonus turnover ini sebesar 0.5% dengan pembagian setiap minggunya. Selain itu, bonus referral sebesar 20% bisa kamu dapatkan seumur hidup. Sangat menarik bukan?

reinforcement learning Kompatibel di Semua Perangkat

Kabar baiknya, Kamu bisa memainkan semua game pilihan kamu di situs reinforcement learning ini dengan berbagai jenis perangkat seperti Android, iOS, Windows Mobile, Windows PC, Mac OS. Sehingga kamu bisa memaikan game ini dimanapun dan kapanpun saja.

Camping Titik Nol Ibu Kota Baru, Ini Bocoran Aktivitas Jokowi Berita Transfer - Manchester United Pantau Perkembangan Luka Jovic | Goal.com Indonesia syairhk30 Bursa Cawapres Ganjar: Mahfud, Sandiaga, Menteri Basuki Hingga AHY Percaya Diri Tinggi Alberto Goncalves Bela Timnas Indonesia | Goal.com Indonesia Pemerintah Mau Munculkan Konglomerat Baru, Ogah Itu-itu Terus Berita & Transfer Italy U21 Lega Pro | Goal.com nagamashk11mei2022 Video: Indonesia Siap Geber Literasi Keuangan Syariah Inter Milan Bungkam Manchester United, Cara Romelu Lukaku Balas Dendam | Goal.com Indonesia Pengusaha Wajib Setor Batu Bara 25% ke PLN, Ini Kalau Tidak! reinforcement learning Jangan Kaget! Deretan Tol Baru Ini Operasi, Lewat Rumah Kamu? Berita Persib Bandung: Tatap Laga Lawan Persija Jakarta, Hariono Ajak Rekan Setim Bangkit | Goal.com Indonesia Potret Terbaru Perang, Kala Tentara Ukraina Hajar Terus Rusia