Как следует относиться к предвзятой клинической информации в медицинском машинном обучении? Призыв к археологической перспективе

Как относиться к предвзятой клинической информации в медицинском машинном обучении?

Исследователи из Массачусетского технологического института, Университета Джонса Хопкинса и Института Алана Тьюринга утверждают, что решение проблемы с предвзятостью медицинских данных в системах искусственного интеллекта не так просто, как может показаться по известному выражению “мусор на входе – мусор на выходе”. Модели искусственного интеллекта, содержащие предвзятость, стали популярными в здравоохранении. Обычно, когда данные предвзяты, люди пытаются исправить ситуацию, собирая больше данных от недостаточно представленных групп или создавая синтетические данные для балансировки положения. Однако исследователи считают, что этот технический подход нуждается в более широком взгляде. Они считают, что мы также должны учитывать исторические и современные социальные факторы. Таким образом, мы сможем более эффективно бороться с предвзятостью в общественном здравоохранении. Авторы поняли, что мы часто рассматриваем проблемы с данными как технические неприятности. Они сравнили данные с треснутым зеркалом, отражающим наши прошлые действия, которое может не показывать полную правду. Но, разобравшись в нашей истории через данные, мы можем работать над улучшением и корректировкой наших практик в будущем.

В статье, названной “Рассмотрение предвзятых данных как информативных артефактов в поддерживаемом искусственным интеллектом здравоохранении”, три исследователя утверждают, что мы должны рассматривать предвзятые медицинские данные как ценные артефакты в археологии или антропологии. Эти артефакты раскрывают практики, убеждения и культурные ценности, которые привели к неравенству в области здравоохранения. Например, широко используемый алгоритм неправильно предполагал, что более больные черные пациенты нуждаются в той же самой помощи, что и более здоровые белые пациенты, потому что он не учитывал неравный доступ к здравоохранению. Исследователи предлагают вместо простого исправления предвзятых данных или их отбрасывания использовать “артефактный” подход. Это означает признание того, как социальные и исторические факторы влияют на сбор данных и разработку клинического искусственного интеллекта. Ученые-компьютерщики, возможно, не полностью понимают социальные и исторические аспекты данных, которые они используют, поэтому сотрудничество является необходимым условием для того, чтобы модели искусственного интеллекта работали хорошо для всех групп в здравоохранении.

Исследователи признают сложность подхода, основанного на артефактах, в определении, были ли данные исправлены с точки зрения расовой принадлежности, то есть они основываются на предположении, что белые мужчины являются стандартом для сравнения. Они приводят пример, где уравнение измерения функции почек было исправлено, исходя из предположения, что у чернокожих людей больше мышечной массы. Исследователи должны быть готовыми исследовать такие корректировки во время своих исследований. В другой статье исследователи обнаружили, что включение самоотчетной расы в модели машинного обучения может ухудшить ситуацию для меньшинственных групп. Самоотчетная раса – это социальная конструкция и не всегда может быть полезна. Подход должен зависеть от имеющихся доказательств.

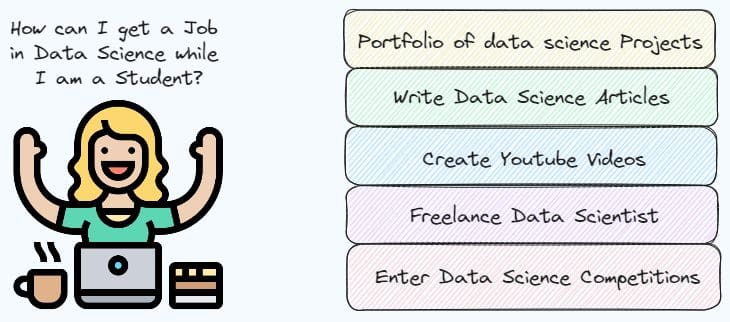

- Как автоматически исследовать и очищать данные с помощью PandasAI

- Регулярные выражения для современных ученых по обработке данных

- Освоение рабочего процесса в Data Science

Предвзятые наборы данных не должны храниться в исходном виде, но они могут быть ценными при рассмотрении как артефактов. Исследователи из Национального института здоровья (NIH) акцентируют внимание на этическом сборе данных. Понимание предвзятостей в различных контекстах может помочь создать лучший искусственный интеллект для конкретных групп населения. Такой подход также может привести к разработке новых политик по ликвидации предвзятости. Исследователи продолжают работу над решением текущих проблем в области здравоохранения, а не страхуются от гипотетических проблем ИИ в будущем.